Wat ik heb geleerd

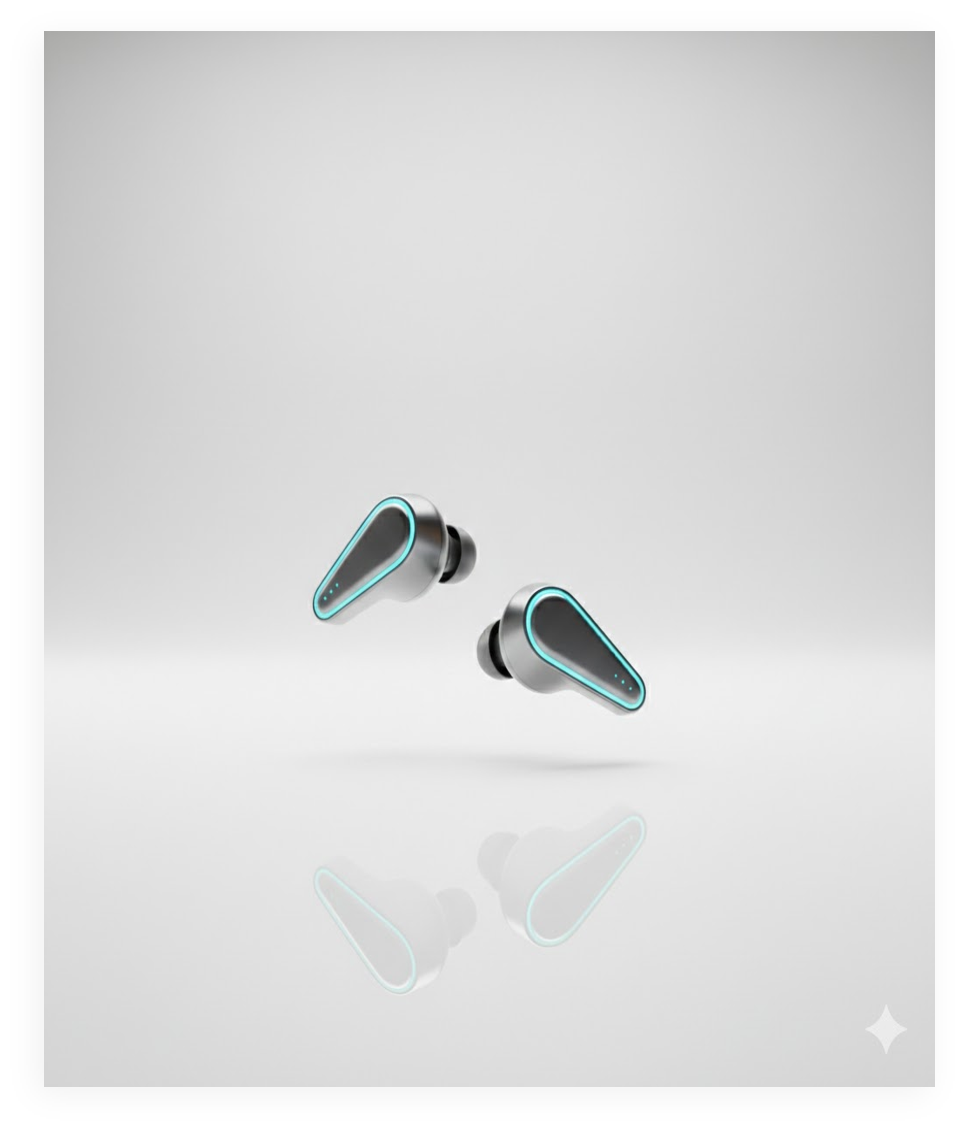

Het PREPARE-framework was mijn eerste kennismaking met gestructureerd prompten. Daarvoor stelde ik gewoon losse vragen aan AI-tools. Dit model dwong me om vooraf na te denken over rol, doelgroep, toon en verwachte output. De output voor LinguoBuds was merkbaar beter dan alles wat ik eerder had gegenereerd.

Toolkeuze

De keuze voor Gemini was bewust: de multimodale mogelijkheden (tekst en beeld in één omgeving) pasten bij de opdracht om een complete contentstrategie te maken. Voor een blogpost, LinkedIn-post en nieuwsbrief in één sessie was Gemini de logische keuze boven ChatGPT of Claude.

Belangrijkste inzicht

De kwaliteit van AI-output hangt direct samen met hoe specifiek je de input formuleert. “Schrijf een blogpost” levert generieke tekst op. “Schrijf een blogpost van 300 woorden voor digitale nomaden over een AI-vertaaloortje, met een enthousiaste en futuristische toon” levert iets bruikbaars op. Dat klinkt logisch, maar in de praktijk is het verschil enorm.

Iteratief werken

Het iteratieve ontwerpproces heeft me laten zien dat je met AI niet alles in één keer moet willen maken. Bij het biometrisch planningsdashboard begon ik met een ruwe schets en verbeterde ik per iteratie één aspect: eerst de visuele hiërarchie, dan het kleurgebruik, dan de UX-flow.

Van schets naar prototype

De Design Thinking methodiek (Interview, Define, Ideate, Prototype, Test, Iterate) gaf structuur aan het ontwerpproces. Per stap stilstaan bij wat werkt en wat niet. De tweede versie van het dashboard was duidelijk beter dan de eerste.

Belangrijkste inzicht

Per iteratie één ding aanpassen geeft meer controle dan alles tegelijk willen veranderen. Dat geldt niet alleen voor ontwerp, maar ook voor hoe je AI-prompts bijstuurt. Kleine, gerichte aanpassingen leiden tot betere resultaten dan alles in één keer herschrijven.

Theorie ontmoet praktijk

De intake bij Blue Line was het moment waarop theorie en praktijk bij elkaar kwamen. Het gesprek met Rob en Ilse leverde informatie op die geen AI-tool kan genereren: hun visie op de winkel als “leukste klerehut”, de trots op de persoonlijke aandacht, en het probleem dat Instagram-beheer “snel tussendoor” gebeurt.

AI als structurerend hulpmiddel

De strategische briefing heb ik opgesteld met hulp van AI, maar de kern kwam voort uit het intakegesprek. De probleemstelling (te lage conversie, versnipperde contentstrategie) is gebaseerd op echte observaties. AI hielp bij het structureren en formuleren, niet bij het bedenken.

Belangrijkste inzicht

AI versterkt je werk, maar vervangt de menselijke input niet. De waardevolste data uit deze opdracht kwam uit het gesprek met Rob en Ilse, niet uit een model. Dat onderscheid is voor mij een van de belangrijkste dingen uit LO1.

Van gebruiker naar bouwer

De Scraper Engine was het moment waarop ik van promptgebruiker naar toolbouwer ging. In plaats van steeds opnieuw dezelfde soort prompt te schrijven, bouwde ik een herbruikbaar systeem met system instructions in Google AI Studio.

Systemen bouwen

Het grote verschil met losse prompts: de engine werkt consistent, ongeacht wie hem gebruikt. De Visualisator als tweede engine (die de output van de scraper automatisch omzet in grafieken) liet zien hoe je AI-tools kunt koppelen tot een workflow.

Belangrijkste inzicht

Met goede system instructions bouw je een herbruikbare tool in plaats van steeds losse prompts te schrijven. Dit is voor mij de meest waardevolle technische vaardigheid uit LO1: denken in systemen, niet in losse vragen.

De casus

In het debat kregen we een casus over emotionele AI in klantcontact. Een verzekeraar gebruikt een chatbot die op basis van tekst herkent hoe je je voelt (boos, gestrest, onzeker) en vervolgens zijn toon aanpast: rustiger, vriendelijker, met meer begrip. Het voordeel is duidelijk: minder irritatie, snellere hulp, hogere tevredenheid. Maar de lastige vraag: is dit nog hulp, of is het stiekem een manier om te sturen?

Verschuiving in mijn denken

In het begin dacht ik: als het de klant helpt, dan is het gewoon goed. Maar door het debat zag ik iets anders: emotieherkenning geeft een bedrijf extra invloed. Jij weet vaak niet wat de AI “denkt” over jouw emotie, en wat er met die info gebeurt. AI kan emoties ook verkeerd lezen: sarcasme of korte app-taal wordt snel verkeerd begrepen.

Mijn standpunt

Transparantie is nummer één. Zeg eerlijk dat iemand met AI chat en dat er een emotie-inschatting plaatsvindt. Geef klanten controle: emotieherkenning aan of uit, en altijd een knop “praat met een medewerker”. Privacy hoort daarbij: emoties zijn gevoelig, dus zo min mogelijk opslaan. De grootste rode vlag: als empathie wordt gebruikt als verkooptruc.

Conclusie

Mijn grens is simpel: empathie mag voor service, niet voor salesdruk. Help eerst, laat marketing wachten. Emotionele AI kan werken, maar alleen met eerlijkheid, keuze en bescherming. Anders ben je vertrouwen kwijt.

Structuur als fundament

Het opzetten van de projectstructuur (PvA, DESTEP, Scrum via Trello) was minder spectaculair dan de AI-tools, maar minstens zo belangrijk. Zonder structuur wordt AI-output een verzameling losse experimenten in plaats van een samenhangend project.

AI in de planning

De DESTEP-analyse en het TLBMC gaven context aan alle andere werkzaamheden. AI hielp bij het invullen van de analyses, maar de prioritering en planning bleef een menselijke taak. De Scrum-aanpak met Trello zorgde ervoor dat het werk behapbaar bleef.

Belangrijkste inzicht

Goede planning maakt het verschil tussen losse AI-experimenten en een samenhangend project. Agile werken met Trello en sprints zorgt ervoor dat je snel kunt itereren zonder het overzicht te verliezen.

Wat ik heb geleerd

De DESTEP-analyse dwong me om breder te kijken dan alleen de winkel en haar klanten. Door systematisch zes dimensies te onderzoeken ontdekte ik verbanden die je anders mist: de EU AI Act heeft direct impact op hoe Blue Line AI-gegenereerde content mag gebruiken, en de groei van Zeewolde als toeristengemeente biedt kansen die je pas ziet als je de demografische data bekijkt.

AI als onderzoekstool

Gemini Deep Research gebruikte ik om per DESTEP-dimensie de trends voor mode-retail in 2026 op te zoeken. De AI combineert bronnen en legt verbanden die je zelf mist. Maar de analyse, wat betekent dit specifiek voor Blue Line, dat blijft mensenwerk.

Belangrijkste inzicht

De macro-omgeving is geen abstracte oefening. Elke DESTEP-dimensie vertaalt zich direct naar strategische keuzes. De technologische dimensie (GenAI) bepaalt welke tools je inzet. De ecologische (circulaire mode) valideert Blue Line’s vermaakservice als strategisch voordeel. De politiek-juridische (AI Act) bepaalt de grenzen van je contentcreatie.

Verder kijken dan winst

Het Triple Layered Canvas veranderde hoe ik naar Blue Line keek. Ik zag ze eerst gewoon als een modewinkel. Door de ecologische en sociale laag uit te werken, ontdekte ik dat de vermaakservice meer is dan klantenbinding. Het is een circulair element in hun businessmodel. En hun rol als dorpskern-versterker is iets dat geen concurrent kan kopiëren.

AI-ondersteunde analyse

Voor het invullen van het canvas gebruikte ik meerdere AI-tools: Perplexity voor harde feiten over textielrecycling en circulaire economie, Gemini voor cross-verificatie en het verbinden van data met Blue Line’s specifieke situatie, en ChatGPT voor roleplay-simulatie vanuit stakeholderperspectief. De combinatie was sterker dan één tool alleen.

Belangrijkste inzicht

Een businessmodel dat alleen economisch klopt is kwetsbaar. Blue Line’s kracht zit in de combinatie: klanten komen voor de kleding (economisch), blijven door de service en levensduurverlenging (ecologisch), en vertellen erover omdat ze zich verbonden voelen met de winkel en Zeewolde (sociaal). Die drie lagen versterken elkaar.

Van gebruiker naar bouwer 2.0

Bij LO1 bouwde ik een Scraper Engine in Google AI Studio met system instructions. De AI Marktanalist was een volgende stap: een volledige webapplicatie, ontworpen en gebouwd met Claude Code. Geen AI Studio, maar een complete applicatie ontwikkeld via AI-assisted development. Een backend die websites crawlt via cURL, HTML parseert met DOMDocument, en op 50+ datapunten scoort.

Theorie in code

De scoringscategorieën zijn niet willekeurig gekozen. Cialdini’s zes overtuigingsprincipes zitten er letterlijk in als analyse-dimensie. De tool zoekt automatisch naar sociale bewijskracht (reviews, testimonials), autoriteit (certificeringen), schaarste (limited offers). Eisenberg’s Hierarchy of Web Usability bepaalt de usability-score. De theorie zit letterlijk in de code.

Belangrijkste inzicht

Een tool bouwen dwingt je om theorie echt te begrijpen. Als je Cialdini’s “sociale bewijskracht” moet vertalen naar detecteerbare HTML-patronen (review-widgets, testimonial-secties, rating-badges), dan begrijp je het principe op een dieper niveau dan wanneer je het alleen in een rapport beschrijft. Bouwen is de beste manier om te leren.

Kaders als lens

Cialdini, Heisenberg en Myers-Briggs zijn drie totaal verschillende frameworks, maar samen vormen ze een complete onderzoekslens. Cialdini vertelt je hoe overtuiging werkt (en hoe je het kunt meten). Heisenberg herinnert je eraan dat je onderzoeksmethode je resultaten beïnvloedt. Myers-Briggs helpt je klanten te begrijpen voorbij leeftijd en woonplaats.

Toepassing op Blue Line

Cialdini paste ik toe in de Marktanalist: Blue Line scoort hoog op sympathie (persoonlijke service) en sociale bewijskracht (9.6/10 beoordeling), maar mist schaarste-elementen online. Heisenberg nam ik mee in het veldonderzoek: in de winkel observeren zonder het koopgedrag te verstoren. Myers-Briggs gebruikte ik voor klantprofilering: de loyale vaste klant (ISFJ) versus de trendbewuste toerist (ESFP).

Belangrijkste inzicht

Theorie zonder toepassing is leeg, data zonder theorie is blind. Het wordt pas interessant als je ze combineert: Cialdini in code, Heisenberg in je methodologie, Myers-Briggs in persona’s. Geen van deze kaders is nieuw, maar ze combineren met AI-tools en met Claude Code gebouwde software. Daar zit de meerwaarde van deze minor.

Aanpak en methodiek

Vijf semi-gestructureerde diepte-interviews van circa tien minuten, telefonisch afgenomen in maart 2026. Drie respondenten gerekruteerd in Zeewolde (door Daaf), twee in Purmerend (door Bradley). Gesprekken opgenomen en getranscribeerd via TurboScribe AI, daarna nagesynchroniseerd. Alle namen geanonimiseerd, mondeling informed consent verkregen.

Respondenten

Sandra V. (47, Zeewolde) — vaste klant, 4-6 bezoeken/jaar. Martijn K. (38, Zeewolde) — vaste klant, 5-7 bezoeken/jaar. Noor W. (29, Zeewolde) — oriënterend, 2 bezoeken. Roos H. (52, Purmerend) — voormalig klant. Tom B. (34, Purmerend) — potentieel nieuw, nooit bezocht. Bewust geselecteerd op leeftijdsspreiding (29-52) en klanttype om de DESTEP-bevinding over de generationele AI-kloof te toetsen.

Vijf terugkerende patronen

1. Conversie-lek = frictie + timing: 4/5 respondenten beschrijven afhaakmomenten. Sandra: “Als het niet direct te vinden is op de site, doe ik het niet meer.”

2. AI-oriëntatie is realiteit: Noor en Tom gebruiken ChatGPT al bij kleding. Tom: “Als ChatGPT Blue Line had genoemd, had ik dat meegenomen.”

3. Eerlijk advies = kernonderscheid: Alle vijf noemen de eerlijkheid van Rob en Ilse als doorslaggevend. Martijn: “Vertrouwen wek je niet met lawaai.”

4. WhatsApp werkt, mits persoonlijk: Alle vijf staan open. Jongeren: max 1x/week. Sandra: “Als het persoonlijk aanvoelt, klik ik het open.”

5. Webshop onbekend buiten regio: Roos wist niet dat Blue Line bezorgt. “Dan had ik er misschien al iets besteld.”

Belangrijkste inzicht

De interviews bevestigen en verdiepen de desk research. Het conversie-lek is geen vermoeden maar een gedocumenteerd patroon. De AEO-urgentie is niet theoretisch maar wordt door twee respondenten spontaan benoemd. De shoppable video-oplossing werd door drie respondenten onafhankelijk van elkaar gesuggereerd. Dat is triangulatie: desk research, data-analyse en veldonderzoek wijzen dezelfde richting op.

Verbeteringen voorgaande LO

Feedback LO1 verwerkt: Bij LO1 ontbraken concrete bronverwijzingen bij de theoretische onderbouwing. Dit is in LO2 verbeterd: alle DESTEP-cijfers zijn voorzien van bronnen (CBS, CPB, INretail, TenneT, Statista). Daarnaast was de koppeling tussen theorie en praktijk in LO1 soms impliciet. In LO2 is elk theoretisch kader (Cialdini, Heisenberg, Myers-Briggs) expliciet vertaald naar een toepassing op Blue Line. Tot slot is de ethische reflectie, die in LO1 alleen bij het debat zat, in LO2 uitgebreid naar de onderzoeksmethodiek: hoe ga je om met AI-gegenereerde onderzoeksdata en bronverificatie.

Kennisverwerving en verantwoording

LO2 bestond uit vier onderdelen: DESTEP (macro-omgeving), Triple Layered Canvas (businessmodel), de AI Marktanalist (gebouwd met Claude Code), en theoretische kaders (Cialdini, Heisenberg, Myers-Briggs). Samen gaat dat verder dan een standaard deskresearch.

Per onderdeel heb ik bewust gekozen welke AI-tools het best pasten. Gemini Deep Research voor de DESTEP vanwege de brede bronvergelijking. Perplexity voor het TLC vanwege de feitelijke nauwkeurigheid. Claude Code voor de Marktanalist omdat ik een herhaalbaar analysesysteem nodig had. AI als ontwikkelpartner voor de hele PHP/JavaScript applicatie.

Bronnen: Cialdini, R. B. (2021). Influence: The Psychology of Persuasion (nieuw herziene editie). Zes overtuigingsprincipes toegepast als scoringsdimensies in de Marktanalist. Eisenberg, B. (2006). Waiting for Your Cat to Bark?, Hierarchy of Web Usability als usability-scoringsmodel. Myers, I. B. & Briggs, K. (MBTI-framework) voor klantprofilering. Heisenberg-onzekerheidsprincipe toegepast als methodologisch bewustzijn bij veldonderzoek. CBS (2024), CPB (2026), INretail (2024), TenneT (2026) en Statista (2024) als databronnen voor de DESTEP. Joyce, A. & Paquin, R. (2016). “The Triple Layered Business Model Canvas” voor het TLC-framework. Collegemateriaal: “Workshop-De-AI-Datafabriek.pdf”, “Deep-Research-DESTEP-De-Globale-Grip.pdf”, “Van deskresearch naar fieldresearch.pptx”, “TLC Minor 18 feb.pdf”.

Promptbeheersing: Voor de DESTEP gebruikte ik Gemini Deep Research met de masterprompt: “Voer een integrale DESTEP-analyse uit voor een fysieke multi-brand modewinkel in Zeewolde, Nederland. Per dimensie: identificeer de drie meest impactvolle trends voor 2025-2026, onderbouw met recente bronnen (CBS, CPB, branchedata), en vertaal elke trend naar een concrete implicatie voor de winkel.” Voor het TLC gebruikte ik Perplexity met rolgebaseerde prompts per laag, en ChatGPT voor roleplay-simulatie vanuit stakeholderperspectief (gemeente, leverancier, klant).

Bewijsvoering

DESTEP: Volledige macro-omgevingsanalyse met zes dimensies, specifiek toegepast op mode-retail in Zeewolde. Niet generiek, maar contextgebonden: de demografische groei van Zeewolde, de ecologische regelgeving rond textiel, de technologische impact van GenAI.

Triple Layered Canvas: Ingevuld canvas met drie lagen voor Blue Line. De economische laag bevestigde de waardepropositie (40+ merken, 9.6/10, koffiebar), de ecologische laag onthulde de vermaakservice als circulair element, de sociale laag toonde de rol als gemeenschapsanker in Zeewolde.

AI Marktanalist: Volledig met Claude Code ontworpen en gebouwde webapplicatie. Backend: PHP met cURL voor webcrawling, DOMDocument voor HTML-parsing, 50+ datapunten per website. Frontend: interactieve radarcharts, vergelijkingsmodus, geschiedenisopslag. Cialdini’s principes en Eisenberg’s Hierarchy als scoringsdimensies geïmplementeerd in code. Claude Code als ontwikkelpartner voor de volledige stack.

Theoretische kaders: Cialdini vertaald naar detecteerbare webpatronen, Heisenberg toegepast in de veldonderzoekmethodologie, Myers-Briggs ingezet voor klantprofilering voorbij demografie.

Toelichting en beheersing

Voor Blue Line levert dit onderzoek iets concreets op. De DESTEP laat zien waar de kansen liggen (toerisme, circulaire mode) en waar de risico’s zitten (AI-regelgeving, online concurrentie). Het TLC maakt zichtbaar dat Blue Line’s kracht vooral in de ecologische en sociale lagen zit, niet alleen in het productaanbod. En de Marktanalist maakt het mogelijk om de concurrentiepositie continu te monitoren in plaats van eenmalig.

Het verschil met LO1 is de diepgang. LO1 ging over tools leren gebruiken, LO2 over tools bouwen en theorie toepassen.

Zelfreflectie en toekomst

Wat ik anders doe na LO2: ik denk niet meer in “wat zegt de data” maar in “welk kader geeft deze data betekenis”. Een website met veel reviews is een feit. Dat dit sociale bewijskracht is (Cialdini) en daarmee een overtuigingsinstrument, is een inzicht. Dat verschil zit tussen rapporteren en interpreteren.

Voor de volgende leeruitkomsten neem ik mee: theorie is geen verplicht nummer. Het is het verschil tussen een analyse en een mening. De AI Marktanalist bewijst dat je met Claude Code theorie kunt operationaliseren in werkende software. Die combinatie van academische kennis en AI-assisted development is wat ik meeneem naar LO3 en verder.

Ethisch dilemma: AI in onderzoek

Bij LO2 gebruikte ik Gemini Deep Research voor de DESTEP-analyse en Perplexity voor het Triple Layered Canvas. Dat levert snel uitgebreide output, maar roept een vraag op: als ik een AI-model laat zoeken naar macro-trends, hoe weet ik dan dat de bronnen kloppen? Gemini presenteert informatie als feit, maar hallucineert soms bronnen of trekt conclusies die niet in de originele bron staan.

Mijn aanpak

Elke cijfermatige claim uit de AI-output heb ik handmatig geverifieerd bij de originele bron. De CBS-cijfers over AI-gebruik (23,4% van de bevolking) heb ik gecontroleerd op cbs.nl. De CPB-koopkrachtramingen (+1,4% in 2026) zijn geverifieerd in het Centraal Economisch Plan 2026. De TenneT-data over netcongestie komt uit hun eigen persbericht van februari 2026. Wat ik niet kon verifiëren, heb ik niet opgenomen.

Mijn standpunt

AI als onderzoekstool is krachtig maar niet betrouwbaar zonder menselijke verificatie. Het risico is dat je AI-output voor waar aanneemt omdat het overtuigend klinkt. Bij de Marktanalist (die websites automatisch scoort) geldt hetzelfde: de tool geeft een score, maar de interpretatie van die score is mensenwerk. Mijn regel: AI mag verzamelen en structureren, maar niet concluderen zonder dat ik de bronnen heb gecontroleerd.

Wat heb ik gedaan?

Een compleet persona-generatieplatform ontworpen en gebouwd. De tool neemt merk, branche en product als input en genereert via de Gemini API een gedetailleerde buyer persona met 40+ datapunten: demografie, persoonlijkheid, doelen, frustraties, mediagedrag en koopgedrag. Daarnaast wordt automatisch een portretfoto gegenereerd via een cascade van drie beeldbronnen (Pexels stockfoto, Pollinations FLUX AI, Gemini beeldgeneratie).

Hoe heb ik het gebouwd?

De volledige tool is gebouwd met Claude Code. Ik bepaalde het ontwerp en de richting, Claude Code schreef de PHP-backend met cURL voor de API-communicatie. De prompt naar Gemini heb ik zo opgebouwd dat het een specifiek JSON-schema verwacht, zodat de output direct machineleesbaar is. Het fallback-systeem voor portretten (Pexels, dan Pollinations FLUX, dan Gemini) en de achtergrondverwijdering via PHP GD zijn ook via Claude Code geïmplementeerd.

De frontend toont persona’s als visuele kaarten met alle datapunten overzichtelijk gegroepeerd. Opgeslagen persona’s zijn direct beschikbaar als input voor de Customer Journey Generator.

Wat heb ik geleerd?

Dat een persona meer is dan een beschrijving. Door 40+ datapunten te structureren, dwing je jezelf om verder te kijken dan de oppervlakte. De keuze voor gestructureerde JSON-output in plaats van vrije tekst was belangrijk: het maakt de persona machineleesbaar en herbruikbaar als input voor andere tools. Het verschil tussen een document en een systeem.

Wat heb ik gedaan?

Een customer journey generator gebouwd die persona-specifieke klantreizen genereert. De tool koppelt automatisch aan een eerder gegenereerde persona en bouwt een volledige journey met vijf fasen: Bewustwording, Overweging, Beslissing, Retentie en Ambassadeurschap. Per fase worden emotiescore, klantgedachten, touchpoints, content types, pijnpunten, kansen en KPI’s gegenereerd.

Hoe heb ik het gebouwd?

De backend leest de volledige persona-data (alle 40+ velden) en bouwt daar een gedetailleerde prompt van. Dat is het verschil met een generieke journey: de touchpoints sluiten aan bij het mediagedrag van de persona, de pijnpunten bij de frustraties, de kansen bij de doelen. De Gemini API genereert gestructureerde JSON die de frontend direct kan renderen als interactieve journey map met emotiecurve.

Daarnaast genereert de tool quick wins en strategische aanbevelingen, concrete acties die uit de journey-analyse volgen.

Wat heb ik geleerd?

Dat de kracht van een customer journey niet in de fasen zit, maar in de persona-specificiteit. Een generieke journey zegt “klant ontdekt merk via social media.” Een persona-specifieke journey zegt “Lisa (34, moeder, Instagram-gebruiker, frustratie: geen tijd voor winkelen) ziet een Reel van Blue Line terwijl ze haar kinderen naar bed brengt.” Dat verschil maakt de journey bruikbaar.

Kennisverwerving en verantwoording

LO3 bestond uit het bouwen van twee AI-tools die op elkaar voortbouwen: de AI Klantenexpert (persona-generator) en de Customer Journey Generator. Van doelgroepdata naar een klantprofiel, en van dat profiel naar een klantreis met touchpoints, emoties en aanbevelingen.

De toolkeuze was bewust: Gemini voor tekstgeneratie vanwege de gestructureerde JSON-output en het ruime contextvenster (nodig om 40+ persona-velden in één prompt te verwerken). Pexels en Pollinations voor portretgeneratie vanwege de realistische output. Claude Code als ontwikkelpartner voor de volledige applicatie: PHP backend, JavaScript frontend, API-integraties. Dat past bij de visie van de minor, waar AI niet alleen het eindproduct is maar ook de manier waarop je bouwt.

Bronnen: Revella, A. (2015). Buyer Personas, als basis voor de 40+ datapunten in de persona-structuur (demografie, psychografie, koopgedrag). Lemon, K. N. & Verhoef, P. C. (2016). “Understanding Customer Experience Throughout the Customer Journey” (Journal of Marketing), als theoretisch kader voor de vijf journey-fasen. Google Gemini API-documentatie voor structured output (JSON mode). Pexels API en Pollinations API-documentatie voor portretgeneratie. Collegemateriaal: “Concurrentie analist GEM.pptx” (Les 1 en 2) voor persona- en concurrentie-analysekaders.

Promptbeheersing: De Gemini-prompt voor persona-generatie is opgebouwd als een gestructureerde JSON-instructie: “Genereer een buyer persona in JSON-formaat met exact de volgende velden: naam, leeftijd, woonplaats, beroep, inkomen, gezinssituatie, persoonlijkheidsscores (extraversie, openheid, zorgvuldigheid elk 1-10), mediagebruik (top 3 kanalen), koopgedrag (frequentie, gemiddelde besteding, triggers, barrières), frustraties (top 3), doelen (top 3), merkloyaliteit (schaal 1-10 met toelichting). Context: [merk], [branche], [product].” Deze prompt dwingt gestructureerde, machineleesbare output af in plaats van vrije tekst.

Bewijsvoering

AI Klantenexpert: Volledig met Claude Code gebouwde webapplicatie. Backend: PHP met cURL voor Gemini API, Pexels API en Pollinations API. Prompt engineering: gestructureerd JSON-schema met 40+ velden als instructie, inclusief persoonlijkheidsscores, mediagedrag en koopgedrag. Portretgeneratie met drievoudig fallback-systeem en automatische achtergrondverwijdering via GD. Frontend: interactieve personakaarten met alle datapunten. Ik gaf de richting, Claude Code schreef de code.

Customer Journey Generator: Bouwt voort op de persona-data. De prompt injecteert alle 40+ personavelden zodat de journey persona-specifiek is: touchpoints sluiten aan bij mediagedrag, pijnpunten bij frustraties, kansen bij doelen. Output: 5 fasen met elk emotiescore, klantgedachten, touchpoints, content types, pijnpunten, kansen, KPI’s en moment of truth. Plus quick wins en strategische aanbevelingen.

Blue Line toepassing: Voor Blue Line Zeewolde is een persona gegenereerd op basis van het merk, de branche (mode-retail) en het product (kledingwinkel met 40+ merken). Deze persona is vervolgens als input gebruikt voor de customer journey, wat resulteerde in een klantreis specifiek voor het profiel en het koopgedrag van de Blue Line-klant.

Toelichting en beheersing

Voor Blue Line betekent dit: in plaats van aannames over de klant, is er nu een datagedreven persona met meetbare kenmerken. En in plaats van een generieke “awareness → purchase” funnel, is er een journey die specifiek aansluit bij hoe de Blue Line-klant zich gedraagt. Welke kanalen gebruikt die persoon, waar loopt die tegenaan, wanneer valt de beslissing.

Technisch heb ik geleerd om met Claude Code API’s in cascade te bouwen (fallback-modellen bij Gemini, fallback-beeldbronnen bij portretten) en om prompts te schrijven die machine-leesbare output afdwingen. De tools bouwen voort op elkaars data: de persona wordt input voor de journey. Mijn rol verschuift van zelf code typen naar AI aansturen om code te produceren.

Zelfreflectie en toekomst

Wat ik meeneem uit LO3: ik denk niet meer in losse tools maar in systemen. De AI Klantenexpert is geen losstaand product. Het is de eerste stap in een pipeline die via de Customer Journey Generator leidt naar marketingacties. Die manier van denken in systemen is wat LO3 onderscheidt van eerdere leeruitkomsten.

Wat ik meeneem: prompt engineering (gestructureerde JSON-instructies), API-architectuur (fallbacks, cascades) en toolintegratie (persona als input voor journey). Dat patroon kan ik herhalen voor andere marketingtools. Claude Code maakt het mogelijk om als marketeer volwaardige webapplicaties te bouwen zonder traditionele programmeerkennis. Dat is precies waar deze minor over gaat.

Ethisch dilemma: AI-gegenereerde persona's

De AI Klantenexpert genereert persona's met 40+ datapunten, inclusief persoonlijkheidsscores, frustraties en koopgedrag. Dat voelt nuttig, maar er zit een risico aan: een AI-gegenereerde persona is geen echte klant. Het is een statistische constructie op basis van patronen in trainingsdata. Als je die persona behandelt als waarheid, neem je beslissingen op basis van een fictief persoon.

Privacy en data

Bij het koppelen van persona's aan de Customer Journey Generator wordt klantgedrag gesimuleerd. Voor Blue Line is dat onschuldig: het zijn hypothetische profielen, geen echte klantdata. Maar als je dezelfde tools zou inzetten met echte klantdata uit een CRM-systeem, verandert het verhaal. Dan genereer je profielen van echte mensen zonder hun expliciete toestemming. De AVG stelt daar grenzen aan, en de EU AI Act (artikel 50) vereist dat je transparant bent over AI-gegenereerde output.

Mijn standpunt

AI-persona's zijn een startpunt, geen eindpunt. Ze helpen om hypotheses te formuleren over klantgedrag, maar moeten altijd gevalideerd worden met echte klantdata. Ons veldonderzoek (5 interviews) doet precies dat: de AI-persona voorspelde bepaalde patronen, het veldonderzoek bevestigde of ontkrachtte die. Transparantie richting de opdrachtgever is essentieel: Rob en Ilse moeten weten dat de persona AI-gegenereerd is en geen vervanging voor hun eigen klantkennis.

Wat ik heb geleerd

De Big Idea voor Blue Line — “Goed gekleed begint bij een gezellig moment” — kwam niet uit het niets. Het begon bij de DESTEP (vereenzaming als macro-trend), de persona (Saskia zoekt sociaal contact) en de concurrentieanalyse (niemand heeft een bar). Het Kantar-model gaf me een concreet framework om het concept te toetsen: is het Meaningful, Distinctive en Salient?

De Noetische Vonk

AI genereerde tientallen campagne-invalshoeken voor Blue Line, maar de bar als concept kwam uit het intakegesprek met Rob en Ilse. De “Noetische Vonk” is het besef dat de beste ideeën ontstaan wanneer je menselijke observaties combineert met data. AI hielp bij het onderbouwen en uitwerken, maar het kernidee kwam van de ondernemer zelf.

Belangrijkste inzicht

Een Big Idea is geen slogan bedenken. Het is de strategische onderbouwing die het concept verbindt met het kernprobleem van de persona, de unieke positie van het merk en de macro-trend die het wind in de rug geeft. Voor Blue Line: Saskia’s behoefte aan contact + de unieke bar + de trend van vereenzaming = een concept dat verdedigbaar is tegenover een opdrachtgever.

Crazy 8’s

De tijdsdruk van één minuut per concept dwong me om mijn innerlijke criticus uit te schakelen. De eerste drie vakken voelden geforceerd, maar vanaf vak vijf kwamen er onverwachte ideeën. Kwantiteit creëert kwaliteit als je bereid bent om ook slechte ideeën op te schrijven.

Reverse Brainstorming

Door bewust na te denken over hoe je kunt falen, ontdek je de randvoorwaarden voor succes. “Maak het zo ingewikkeld mogelijk” wordt de randvoorwaarde “extreme eenvoud in de boodschap”. Een verrassend effectieve manier om scherper te denken.

Belangrijkste inzicht

Creatieve technieken en AI versterken elkaar. AI genereert de kwantiteit en brengt onverwachte invalshoeken, de creatieve technieken helpen je om te selecteren en samen te smelten tot één sterk concept.

Van gebruiker naar bouwer

Bij LO1 leerde ik prompten. Bij LO3 bouwde ik twee tools met Claude Code. De Agency Simulator was de volgende stap: niet één tool met één functie, maar een systeem van vijf samenwerkende AI-agents. Briefing, Strategie, Creative Director, Media Planner en Contentkalender — elke agent heeft een eigen specialisatie en levert input voor de volgende.

Metacognitie

Het krachtigste aan de Agency Simulator was de dubbelrol: marketeer én architect tegelijk. Door mijn eigen Blue Line analyses in de tool te voeren, zag ik direct waar ze tekortschoten. De Briefing Agent signaleerde hiaten die ik zelf over het hoofd had gezien. Dat is metacognitie: nadenken over hoe je denkt, via de feedback van je eigen systeem.

Belangrijkste inzicht

De stap van Gebruiker naar Maker verandert je relatie met AI. Je stelt niet langer vragen — je ontwerpt het systeem dat de vragen stelt, beoordeelt en itereert. De Agency Simulator is gebouwd met Claude Code, net als de eerdere tools, maar nu met meerdere agents die samen een complete campagnestrategie opleveren. Dat is de stap van marketeer naar AI-architect.

Overzicht

LO4 bestond uit twee kernonderdelen: de Big Idea workshop (van analyse naar creatief concept) en de AI-Architect workshop (van AI-gebruiker naar systeembouwer). Samen vormen ze de brug tussen het analytische werk van LO1–3 en de creatieve uitvoering die komt.

Groei

Het verschil met eerdere leeruitkomsten: bij LO1 leerde ik prompten, bij LO2 analyseren, bij LO3 tools bouwen. LO4 combineerde dit alles: de analyses als input, AI als versneller, en creatieve technieken als selectiemethode. De output is niet meer data of een tool, maar een creatief concept dat geworteld is in onderzoek.

Belangrijkste inzicht

De creatieve sprong van data naar verhaal is niet willekeurig. Het is onderbouwd met het Kantar-model, gevoed door DESTEP en persona-analyses, en versterkt door AI als lateral thinker. Maar de uiteindelijke keuze — de Noetische Vonk — is en blijft mensenwerk. Dat is het verschil tussen een campagne die klopt en een campagne die raakt.

Kennisverwerving en verantwoording

LO1 bestond uit zes opdrachten. Van het leren prompten (Content Machine) naar iteratief ontwerpen (Design Thinking), ethische reflectie, toepassing op Blue Line, het bouwen van een Scraper Engine, en de projectstructuur.

Per onderdeel heb ik bewust gekozen welke AI-tool het beste past. Gemini voor de Content Machine vanwege de multimodale mogelijkheden: tekst, beeld en video in dezelfde omgeving, ideaal voor een campagne die blogpost, LinkedIn-post en nieuwsbrief vereist. Google AI Studio voor de Scraper Engine, omdat je daar met system instructions herbruikbare tools kunt bouwen die consistent werken ongeacht wie ze gebruikt. Ik heb per opdracht gekeken welk model het sterkst is voor dat type output.

Theoretisch leun ik op het PREPARE-framework (Prompt, Rol, Expliciet, Parameters, Ask, Rate, Emotions) als basis voor promptstructuur, geïntroduceerd in de les “GEN AI PROMPT INTRO” (collegemateriaal semester 2). De concrete uitwerking voor LinguoBuds liet zien dat het verschil tussen een generieke prompt en een gestructureerde PREPARE-prompt enorm is: waar “schrijf een blogpost” vage output oplevert, genereert “schrijf een blogpost van 300 woorden voor digitale nomaden over een AI-vertaaloortje, met een enthousiaste en futuristische toon” direct bruikbare tekst.

Bronnen: PREPARE-framework (collegemateriaal GEN AI PROMPT INTRO sem2.pptx). Design Thinking: Brown, T. (2009). Change by Design, toegepast via de zes fasen (Observe, Define, Ideate, Prototype, Test, Iterate) uit lesmateriaal “Lesdag 1 Design Thinking_D.pptx”. Google AI Studio documentatie voor system instructions en structured prompts. Gemini API-documentatie voor multimodale contentgeneratie.

Bewijsvoering

Per les zijn concrete, aantoonbare producten opgeleverd:

Content Machine: Volledige PREPARE-masterprompt voor LinguoBuds met drie gegenereerde contentstukken (blogpost, LinkedIn-post, nieuwsbrief). De prompt definieerde rol (Senior Brand Manager travel-tech), doelgroep (digitale nomaden), parameters (drie formaten, prijs €99) en toon (futuristisch, menselijk).

Design Thinking: Twee iteraties van een biometrisch planningsdashboard. De eerste versie (prototype) had zwakke visuele hiërarchie, de tweede (verbeteringsslag) was aanzienlijk sterker door per iteratie één aspect bij te sturen: eerst kleurgebruik, dan UX-flow.

Briefing Blue Line: Strategische briefing op basis van het intakegesprek met Rob Bleeker en Ilse de Groot. Probleemstelling, doelstellingen (10% engagement in 4-weken pilot), en inzichten die geen AI-tool kan genereren: hun visie op de winkel, de hack van de locatie-tag, Instagram “snel tussendoor”.

MarCom Scraper: Twee werkende AI Engines in Google AI Studio. Engine 1 (Scraper) filtert ruis van websites en screenshots tot gestructureerde data. Engine 2 (Visualisator) zet die data automatisch om in grafieken via Code Execution. Samen vormen ze een workflow.

Ethiek: Debatscript over emotionele AI in klantcontact (verzekeraar-casus) met onderbouwd standpunt en videoreflectie.

Geen van deze outputs is onbewerkt overgenomen. Bij de Content Machine paste ik de toon aan, bij de briefing vulde ik AI-suggesties aan met eigen observaties uit de intake, en bij de Scraper verfijnde ik de system instructions stap voor stap.

Toelichting en beheersing

Voor Blue Line als MKB-opdrachtgever werkt deze aanpak: de Scraper Engine bespaart uren handmatig data verzamelen, en de briefing geeft structuur aan een marketingaanpak die ze door tijdgebrek anders niet zouden opzetten. Rob en Ilse hebben geen tijd voor diepgaand marktonderzoek. Een tool die in minuten een website analyseert verschuift het werk van verzamelen naar interpreteren.

Voor mezelf als toekomstig marketeer leer ik denken in systemen in plaats van losse taken. Het PREPARE-framework beheers ik inmiddels goed genoeg om consistent bruikbare output te genereren. Het Design Thinking proces liet zien dat kleine, gerichte iteraties (per keer één ding aanpassen) meer controle geven dan alles tegelijk herschrijven. Dat geldt niet alleen voor ontwerp, maar ook voor hoe je AI-prompts bijstuurt.

Ethiek

Het debat over emotionele AI in klantcontact heeft mijn denken verschoven. De casus: een verzekeraar gebruikt een chatbot die op basis van tekst herkent hoe je je voelt en zijn toon aanpast. In eerste instantie leek het simpel: als de klant er beter van wordt, is het goed. Maar door het debat zag ik iets anders: emotieherkenning geeft een bedrijf extra invloed. De klant weet vaak niet wat de AI “denkt” over zijn emotie, en AI kan sarcasme of korte app-taal verkeerd interpreteren.

Mijn standpunt na het debat: transparantie is nummer één. Zeg eerlijk dat iemand met AI chat en dat er een emotie-inschatting plaatsvindt. Geef klanten controle (emotieherkenning aan/uit, knop voor menselijke medewerker). En de harde grens: empathie mag voor service, nooit voor salesdruk. Als een klant boos is over een afwijzing, mag de chatbot niet die emotie gebruiken om een duurder pakket te verkopen.

Dit inzicht neem ik mee naar de Blue Line-opdracht: ook bij contentcreatie met AI moet je transparant zijn over wat AI-gegenereerd is en wat niet. Zeker voor een winkel als Blue Line die draait op persoonlijke aandacht.

Zelfreflectie en toekomst

Wat ik bij mezelf merk: ik denk niet meer in “wat kan AI voor mij maken” maar in “hoe stuur ik AI aan”. De zes opdrachten van LO1 hangen samen. Het PREPARE-framework uit les 1 gebruik ik als basis voor alle prompts daarna, het iteratieve denken uit Design Thinking pas ik toe bij het bijsturen van AI-output, en de ethische grens uit het debat bepaalt hoe ik AI inzet voor Blue Line.

Voor Blue Line wil ik de system-instructions aanpak uit de Scraper Engine toepassen op terugkerende taken: social media planning, contentkalenders, rapportages. Gestructureerd prompten (PREPARE), de juiste tool per taak, en nadenken over wanneer AI helpt en wanneer niet. Dat neem ik mee naar LO2 en verder.